Erschließung des Potenzials von Liquiditäts-Restaking in dezentralen physischen Infrastrukturnetzwer

Erschließung des Potenzials von Liquiditäts-Restaking in dezentralen physischen Infrastrukturnetzwerken (DePIN)

Im dynamischen Umfeld von Technologie und Finanzen kristallisiert sich die Schnittstelle zwischen dezentralen physischen Infrastrukturnetzwerken (DePIN) und Liquiditäts-Restaking als zentraler Innovationspunkt heraus. Diese Konvergenz bedeutet nicht nur die Kombination zweier unterschiedlicher Bereiche, sondern ebnet den Weg für einen neuen Ansatz, der beide revolutionieren könnte. Lassen Sie uns untersuchen, wie Liquiditäts-Restaking im DePIN-Bereich beispiellose Synergien freisetzen kann.

DePIN verstehen: Die neue Grenze

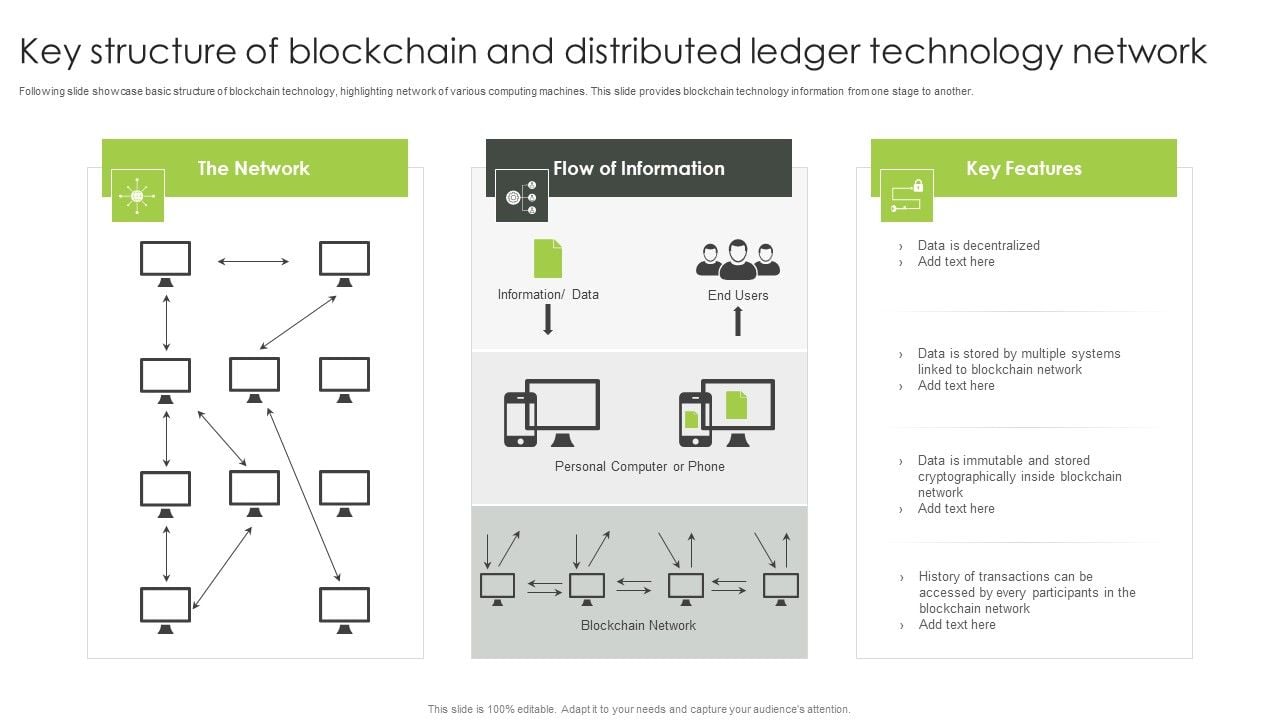

DePIN stellt einen neuartigen Ansatz für die Nutzung dezentraler Netzwerke in der physischen Infrastruktur dar. Stellen Sie sich eine Welt vor, in der Rechenzentren, Energienetze und sogar Verkehrsnetze mithilfe der Blockchain-Technologie verwaltet werden. Dieses dezentrale Framework ermöglicht eine effizientere, transparentere und sicherere Verwaltung dieser kritischen Anlagen.

In herkömmlichen Umgebungen ist die Verwaltung dieser physischen Infrastrukturen mit erheblichen Kosten und komplexer Logistik verbunden. DePIN zielt darauf ab, diese Abläufe zu dezentralisieren, die Abhängigkeit von zentralen Stellen zu verringern und einen demokratischeren Ansatz für das Infrastrukturmanagement zu fördern. Der eigentliche Clou ist jedoch die Integration von Liquiditäts-Restaking.

Was ist Liquiditäts-Restaking?

Liquidity Restaking ist ein Konzept aus dem breiteren DeFi-Bereich (Decentralized Finance). Dabei wird dezentralen Börsen oder Liquiditätspools Liquidität zur Verfügung gestellt, und man erhält dafür Restaking-Belohnungen. Im Wesentlichen handelt es sich um eine Methode, passives Einkommen durch das Staking von Liquidität auf DeFi-Plattformen zu generieren. Die Belohnungen stammen aus Transaktionsgebühren und anderen Anreizen der Plattform.

Wenn wir jedoch im Kontext von DePIN über Liquiditäts-Restaking sprechen, erweitern wir dessen Anwendungsbereich erheblich. Liquidität beschränkt sich hier nicht nur auf digitale Vermögenswerte, sondern umfasst auch die operative Effizienz und das Ressourcenmanagement physischer Infrastruktur.

Die Synergien zwischen Liquiditäts-Restaking und DePIN

Die Synergie zwischen Liquidity Restaking und DePIN liegt in ihrem gemeinsamen Ziel, Ressourcenallokation und Effizienz zu optimieren. Beide zielen darauf ab, den Nutzen ihrer jeweiligen Netzwerke durch aktive Teilnahme und Ressourcenteilung zu maximieren. So funktionieren diese Synergien:

Verbesserte Ressourcennutzung:

In einem DePIN-Ökosystem werden Ressourcen wie Energie, Bandbreite und physischer Platz oft nicht optimal genutzt. Durch die Integration von Liquiditäts-Restaking können diese Ressourcen dynamisch zugewiesen werden, um die Leistung zu optimieren. Beispielsweise könnte ein dezentrales Energienetz überschüssige Energie dorthin verteilen, wo sie am dringendsten benötigt wird, und dabei Restaking-Belohnungen verdienen.

Anreize zur Teilnahme schaffen:

Eine der größten Herausforderungen bei DePIN besteht darin, Teilnehmer zur Mitarbeit zu bewegen. Liquiditäts-Restaking bietet einen starken Anreiz zur aktiven Teilnahme. Durch die Bereitstellung von Restaking-Belohnungen kann DePIN mehr Einzelpersonen und Organisationen dazu anregen, ihre Ressourcen beizusteuern und so die Gesamteffizienz und Zuverlässigkeit des Netzwerks zu verbessern.

Dezentrale Regierungsführung:

Auch das Restaking von Liquidität kann in der dezentralen Governance innerhalb von DePIN-Netzwerken eine Rolle spielen. Teilnehmer, die Liquidität bereitstellen, erhalten Stimmrechte und können so Entscheidungen über Netzwerkerweiterungen, Ressourcenverteilung und Betriebsrichtlinien beeinflussen. Dieser demokratische Ansatz gewährleistet, dass sich das Netzwerk entsprechend den Bedürfnissen seiner Teilnehmer weiterentwickelt.

Finanzielle Inklusion:

Durch die Nutzung von Liquiditäts-Restaking kann DePIN finanzielle Vorteile einem breiteren Publikum zugänglich machen. Personen, die keinen direkten Zugang zu traditionellen Finanzsystemen haben, können sich am Netzwerk beteiligen, indem sie Ressourcen beisteuern und dafür Restaking-Belohnungen erhalten. Dies demokratisiert den Zugang zu finanziellen Möglichkeiten und macht sie inklusiver.

Fallstudien und Anwendungen in der Praxis

Um die praktischen Auswirkungen des Liquiditäts-Restakings in DePIN zu verstehen, betrachten wir einige Beispiele aus der Praxis:

Energienetze:

Stellen Sie sich ein dezentrales Energienetz vor, in dem überschüssige Energie aus erneuerbaren Quellen mit Gebieten geteilt wird, die mehr Strom benötigen. Teilnehmer des Netzes können durch die Bereitstellung ihrer überschüssigen Energie sogenannte Restaking-Belohnungen verdienen. Dies motiviert weitere Menschen, dem Netzwerk beizutreten und zu einer stabileren und effizienteren Energieversorgung beizutragen.

Rechenzentren:

In einem dezentralen Rechenzentrumsnetzwerk können ungenutzte Rechenleistung und Speicherkapazität gebündelt und denjenigen Nutzern zugewiesen werden, die sie am dringendsten benötigen. Durch das Staking von Liquidität können Teilnehmer Belohnungen verdienen, was zu weiteren Beiträgen anregt und die Gesamtleistung des Netzwerks optimiert.

Verkehrsnetze:

Ein dezentrales Verkehrsnetz könnte ungenutzte Fahrzeuge als Teil seiner Infrastruktur nutzen. Durch das Bereitstellen von Liquidität können Fahrzeughalter für ihren Beitrag Retaking-Belohnungen erhalten, was mehr Menschen zur Teilnahme anregt und ein robusteres und zuverlässigeres Verkehrsnetz gewährleistet.

Zukunftsperspektiven und Herausforderungen

Das Potenzial von Liquiditäts-Restaking in DePIN ist zwar immens, aber nicht ohne Herausforderungen. Die Integration dieser beiden Konzepte erfordert die Überwindung technischer, regulatorischer und gesellschaftlicher Hürden. Die Folgen eines Erfolgs könnten jedoch bahnbrechend sein.

Technische Integration:

Die nahtlose Integration von Finanzliquiditätsmechanismen und dem Management physischer Infrastrukturen zu gewährleisten, ist eine komplexe Aufgabe. Sie erfordert robuste Blockchain-Technologie, fortschrittliche Algorithmen und sichere Protokolle für die effiziente Verwaltung und Zuweisung von Ressourcen.

Einhaltung gesetzlicher Bestimmungen:

Die Navigation durch den regulatorischen Dschungel kann eine Herausforderung sein. Regierungen haben möglicherweise unterschiedliche Ansichten darüber, wie dezentrale Netzwerke funktionieren sollten, insbesondere im Finanzbereich. Die Einhaltung der Vorschriften unter Wahrung des dezentralen Prinzips ist daher von entscheidender Bedeutung.

Öffentliche Adoption:

Die Förderung der öffentlichen Akzeptanz von DePIN-Netzwerken ist entscheidend. Dazu ist es notwendig, die Menschen über die Vorteile aufzuklären und etwaige Missverständnisse über dezentrale Systeme auszuräumen. Vertrauen aufzubauen und konkrete Vorteile aufzuzeigen, ist für eine breite Akzeptanz unerlässlich.

Abschluss

Die Verschmelzung von Liquiditäts-Restaking mit dezentralen physischen Infrastrukturnetzwerken (DePIN) stellt ein aufregendes Innovationsfeld dar. Durch die Erschließung neuer Synergien verspricht diese Integration eine optimierte Ressourcenzuweisung, Anreize zur Teilnahme und einen demokratisierten Zugang zu Finanzmöglichkeiten. Obwohl weiterhin Herausforderungen bestehen, machen die potenziellen Vorteile diesen Bereich besonders interessant und vielversprechend. Die Zukunft von DePIN, basierend auf Liquidity Restaking, könnte die Art und Weise, wie wir physische Infrastruktur verwalten und nutzen, grundlegend verändern – dezentral, effizient und inklusiv.

Die Zukunft des Liquiditäts-Restakings in dezentralen physischen Infrastrukturnetzwerken (DePIN)

Aufbauend auf den grundlegenden Synergien, die wir untersucht haben, beleuchtet dieser Abschnitt die zukünftigen Auswirkungen der Integration von Liquiditäts-Restaking in dezentrale physische Infrastrukturnetzwerke (DePIN). Im weiteren Verlauf dieser spannenden Schnittstelle werden wir die technologischen Fortschritte, gesellschaftlichen Auswirkungen und innovativen Wege aufzeigen, die diese Verschmelzung zu eröffnen verspricht.

Technologische Fortschritte

Blockchain-Evolution:

Das Rückgrat von DePIN und Liquidity Restaking bildet die Blockchain-Technologie. Mit ihrer Weiterentwicklung wird sie eine entscheidende Rolle bei der nahtlosen Integration von Finanz- und Infrastrukturmanagement spielen. Fortschrittliche Blockchain-Protokolle ermöglichen schnellere, sicherere und effizientere Transaktionen und fördern so ein robusteres DePIN-Ökosystem.

Intelligente Verträge:

Smart Contracts werden die Funktionsweise des Liquiditäts-Restakings innerhalb von DePIN revolutionieren. Diese selbstausführenden Verträge können die Ressourcenzuweisung automatisieren, die Belohnungsverteilung verwalten und Netzwerkregeln ohne die Notwendigkeit von Intermediären durchsetzen. Diese Automatisierung wird die Effizienz und Zuverlässigkeit von DePIN-Netzwerken verbessern.

Interoperabilität:

Die Gewährleistung der Interoperabilität zwischen verschiedenen Blockchain-Netzwerken und physischen Infrastruktursystemen ist für die breite Akzeptanz von DePIN unerlässlich. Zukünftige Fortschritte bei Interoperabilitätsprotokollen werden es verschiedenen DePIN-Netzwerken ermöglichen, nahtlos miteinander zu kommunizieren und Ressourcen zu teilen, wodurch ein stärker vernetztes und effizienteres Infrastruktur-Ökosystem entsteht.

Maschinelles Lernen und KI:

Durch die Integration von maschinellem Lernen und künstlicher Intelligenz in DePIN-Netzwerke lassen sich Ressourcenmanagement optimieren und Nachfragemuster vorhersagen. Diese Technologien analysieren große Datenmengen, um Ineffizienzen zu erkennen und Verbesserungsvorschläge zu unterbreiten. So wird eine effektivere Ressourcenzuweisung gewährleistet und Verschwendung reduziert.

Wirtschaftliche und finanzielle Innovationen

Cross-Asset-Liquiditätspools:

Liquiditäts-Restaking kann über digitale Vermögenswerte hinaus auf physische Vermögenswerte ausgeweitet werden. Es lassen sich vermögensübergreifende Liquiditätspools schaffen, in denen Teilnehmer digitale und physische Vermögenswerte einbringen und dafür Restaking-Belohnungen erhalten können. Dies könnte zur Entstehung hybrider Infrastrukturnetzwerke führen, die die Vorteile beider Welten vereinen.

Dezentrale autonome Organisationen (DAOs):

Der Aufstieg von DAOs kann eine wichtige Rolle bei der Verwaltung von DePIN-Netzwerken spielen. DAOs können die Ressourcenverteilung steuern, Entscheidungen über Netzwerk-Upgrades treffen und Restaking-Belohnungen verwalten. Dieses dezentrale Governance-Modell gewährleistet, dass sich das Netzwerk entsprechend den Bedürfnissen und Beiträgen seiner Teilnehmer weiterentwickelt.

Mikrozahlungssysteme:

Die Integration von Mikrozahlungssystemen in DePIN-Netzwerke kann kleinere Transaktionen und Beiträge erleichtern. Diese Systeme ermöglichen es mehr Menschen, sich zu beteiligen, auch solchen mit begrenzten Ressourcen, und fördern so mehr Inklusion und Teilhabe.

Gesellschaftliche Auswirkungen

Umweltverträglichkeit:

Einer der bedeutendsten gesellschaftlichen Auswirkungen des Liquiditäts-Restakings in DePIN ist das Potenzial für mehr ökologische Nachhaltigkeit. Durch die Optimierung der Ressourcenzuweisung können DePIN-Netzwerke Abfall und Energieverbrauch reduzieren. Beispielsweise kann ein dezentrales Energienetz eine effizientere Energienutzung gewährleisten und so den gesamten CO₂-Fußabdruck verringern.

Wirtschaftliche Stärkung:

In der sich ständig weiterentwickelnden Welt der Softwareentwicklung bleibt die Frage nach modularen und monolithischen Architekturen ein viel diskutiertes Thema. Mit Blick auf das Jahr 2026 steht die digitale Landschaft vor bedeutenden Veränderungen, und die Architektur, die sich durchsetzt, wird die Zukunft der Entwicklung und Wartung von Softwaresystemen maßgeblich prägen.

Die Grundlagen verstehen

Zunächst wollen wir klären, was wir unter modularen und monolithischen Architekturen verstehen. Eine monolithische Architektur bezeichnet eine einzige, einheitliche Struktur, in der alle Komponenten eng miteinander verbunden sind. Das bedeutet, dass alles Teil eines großen Systems ist. Im Gegensatz dazu zerlegt eine modulare Architektur das System in eigenständige Module oder Komponenten, die unabhängig voneinander funktionieren können. Jedes Modul ist für die Erfüllung einer spezifischen Funktion ausgelegt und kann unabhängig entwickelt, getestet und eingesetzt werden.

Der Reiz monolithischer Architektur

Monolithische Architekturen gibt es schon seit Jahrzehnten und sie bieten bestimmte Vorteile, die sie attraktiv machen:

Einfachheit: Monolithische Systeme sind unkompliziert zu entwickeln und zu verstehen. Wenn sich alles an einem Ort befindet, ist es einfacher, sich ein vollständiges Bild von der Funktionalität des Systems zu verschaffen.

Leistung: In einer monolithischen Architektur entsteht oft weniger Overhead, da weniger Kommunikation zwischen Prozessen oder Systemen erforderlich ist. Dies kann zu einer besseren Leistung und geringeren Latenz führen.

Einfache Bereitstellung: Die Bereitstellung einer monolithischen Anwendung ist oft einfacher. Da nur eine einzige Einheit bereitgestellt werden muss, ist der Prozess in der Regel weniger kompliziert als die Verwaltung mehrerer unabhängiger Dienste.

Diese Einfachheit hat jedoch ihren Preis. Monolithische Architekturen können mit zunehmender Größe unübersichtlich werden. Die enge Kopplung der Komponenten erschwert es, Teile des Systems zu aktualisieren oder umzustrukturieren, ohne die gesamte Anwendung zu beeinträchtigen.

Der Aufstieg der modularen Architektur

Modulare Architekturen, insbesondere in Form von Microservices, haben im letzten Jahrzehnt stark an Popularität gewonnen. Die Modularität dieser Systeme bietet mehrere überzeugende Vorteile:

Skalierbarkeit: Modulare Systeme, insbesondere Microservices, ermöglichen eine gezielte Skalierung. Einzelne Komponenten können bedarfsgerecht skaliert werden, ohne das Gesamtsystem zu beeinträchtigen.

Wartbarkeit: Unabhängige Module erleichtern die Wartung und Aktualisierung spezifischer Systemteile. Teams können gleichzeitig an verschiedenen Modulen arbeiten, ohne sich gegenseitig zu behindern.

Flexibilität: Modulare Architekturen ermöglichen den Einsatz unterschiedlicher Technologien für verschiedene Module. Diese Flexibilität kann zu höherer Leistung und Innovation führen, da Teams das jeweils beste Werkzeug für die jeweilige Aufgabe auswählen können.

Der Nachteil modularer Architekturen besteht jedoch darin, dass sie Komplexität mit sich bringen können. Die Verwaltung mehrerer unabhängiger Dienste erfordert eine ausgefeilte Orchestrierung und oft einen höheren Aufwand in Bezug auf Infrastruktur und Kommunikation zwischen den Diensten.

Die Rolle von DevOps und Cloud Computing

Im Jahr 2026 wird die Rolle von DevOps und Cloud Computing entscheidend dafür sein, welche der beiden Architekturen sich durchsetzen wird. DevOps-Praktiken betonen Zusammenarbeit und Automatisierung, die von modularen Architekturen naturgemäß besser unterstützt werden. Der Microservices-Ansatz passt perfekt zu den DevOps-Prinzipien und ermöglicht kontinuierliche Integration und Bereitstellung.

Cloud Computing spielt ebenfalls eine wichtige Rolle. Die Elastizität und Skalierbarkeit von Cloud-Diensten machen modulare Architekturen attraktiver. Cloud-Plattformen ermöglichen die mühelose Skalierung und Bereitstellung unabhängiger Dienste, was in monolithischen Umgebungen deutlich schwieriger ist.

Branchentrends und Prognosen

Die Branchentrends deuten auf einen Wandel hin zu modulareren Architekturen. Der wachsende Bedarf an Skalierbarkeit, Flexibilität und kurzen Entwicklungszyklen veranlasst Unternehmen, Microservices und andere modulare Ansätze einzuführen. Immer mehr Unternehmen setzen auf containerisierte Umgebungen wie Kubernetes, die modulare Designs zusätzlich unterstützen.

Schlussfolgerung zu Teil 1

Während monolithische Architekturen Einfachheit und problemlose Implementierung bieten, gewinnen modulare Architekturen hinsichtlich Skalierbarkeit, Wartbarkeit und Flexibilität zunehmend an Bedeutung. Mit Blick auf das Jahr 2026 dürfte der modulare Ansatz, unterstützt durch DevOps und Cloud Computing, die Technologielandschaft dominieren. Dabei sollte man jedoch nicht vergessen, dass die beste Architektur oft von den spezifischen Projektanforderungen abhängt und manchmal eine Kombination beider Ansätze die optimale Lösung darstellt.

Hybride Ansätze annehmen

Obwohl der modulare Ansatz vielversprechend für die Zukunft erscheint, ist es wichtig zu erkennen, dass nicht alle Projekte ihre Architektur komplett überarbeiten müssen. Manchmal bietet ein hybrider Ansatz, der Elemente modularer und monolithischer Architekturen kombiniert, die Vorteile beider Welten.

Balanceakt: Hybridarchitekturen

Hybridarchitekturen vereinen die Einfachheit und den unkomplizierten Einsatz monolithischer Systeme mit der Skalierbarkeit und Flexibilität modularer Systeme. Dieser Ansatz ermöglicht es Unternehmen, schrittweise zu einer modulareren Struktur überzugehen, ohne eine vollständige Umstrukturierung vornehmen zu müssen.

Inkrementelle Migration: Beginnen Sie damit, die wichtigsten Komponenten zu identifizieren, die unabhängig skalieren müssen, und teilen Sie diese in separate Module auf. Dieser inkrementelle Ansatz minimiert das Risiko und ermöglicht eine schrittweise Anpassung.

Mikrodienste in einem Monolithen: Große monolithische Anwendungen können Mikrodienste für spezifische Funktionalitäten enthalten. Dadurch können Teile des Systems von den Vorteilen einer modularen Architektur profitieren, ohne die bestehende Struktur vollständig aufzulösen.

API-First-Design: Nutzen Sie APIs, um Funktionalitäten des monolithischen Systems für neue Microservices bereitzustellen. Dies ermöglicht einen reibungslosen Übergang und erhält die Integrität des bestehenden Systems bei gleichzeitiger Einführung modularer Komponenten.

Herausforderungen und Überlegungen

Hybridarchitekturen bieten zwar einen ausgewogenen Ansatz, bringen aber auch eigene Herausforderungen mit sich:

Komplexität: Die Verwaltung sowohl monolithischer als auch modularer Komponenten erhöht die Komplexität. Teams müssen beide Architekturen beherrschen, um eine reibungslose Integration und einen reibungslosen Betrieb zu gewährleisten.

Datenmanagement: Datenkonsistenz und -verwaltung werden komplexer, wenn Teile des Systems unabhängig voneinander arbeiten. Die Gewährleistung der Datenintegrität über modulare Komponenten hinweg erfordert sorgfältiges Design und robuste Orchestrierung.

Bereitstellung und Betrieb: Die Bereitstellung eines Hybridsystems erfordert ausgefeilte Orchestrierungs- und Überwachungstools. Es kann eine Herausforderung sein, sicherzustellen, dass monolithische und modulare Komponenten in der Cloud-Umgebung harmonisch zusammenarbeiten.

Zukunftssichere Architektur

Mit Blick auf das Jahr 2026 ist es entscheidend, Ihre Architektur zukunftssicher zu gestalten, um sich an die sich wandelnden Geschäftsanforderungen und technologischen Fortschritte anzupassen. Hier sind einige Strategien, die Sie in Betracht ziehen sollten:

Kontinuierliche Evaluierung: Überprüfen Sie Ihre Architektur regelmäßig, um Bereiche zu identifizieren, die von einer Modularisierung profitieren könnten. Nutzen Sie Kennzahlen wie Leistung, Skalierbarkeit und Wartbarkeit als Entscheidungsgrundlage.

Investieren Sie in Weiterbildung: Stellen Sie sicher, dass Ihre Entwicklungsteams sowohl mit monolithischen als auch mit modularen Architekturen vertraut sind. Kontinuierliches Lernen und Training helfen Ihrem Team, sich an neue Technologien und Vorgehensweisen anzupassen.

Nutzen Sie Cloud und DevOps: Setzen Sie auf Cloud Computing und DevOps-Praktiken, um die Vorteile modularer Architekturen voll auszuschöpfen. Cloud-Plattformen bieten die für Microservices erforderliche Skalierbarkeit und Flexibilität, während DevOps-Praktiken die Zusammenarbeit und die Effizienz der Bereitstellung verbessern.

Das endgültige Urteil: Modular gewinnt, aber nicht ohne Nuancen

Im Großen und Ganzen dürften modulare Architekturen den Marktanstieg 2026 dominieren, insbesondere in Form von Microservices. Die damit verbundene Skalierbarkeit, Wartbarkeit und Flexibilität sind unbestreitbar. Es ist jedoch wichtig zu erkennen, dass die beste Architektur oft eine differenzierte Kombination darstellt, die auf die spezifischen Bedürfnisse des jeweiligen Projekts zugeschnitten ist.

Monolithische Architekturen haben nach wie vor ihre Berechtigung, insbesondere für einfachere, weniger anspruchsvolle Anwendungen. Hybride Ansätze bieten einen pragmatischen Weg für Organisationen, die schrittweise zu modulareren Systemen übergehen möchten.

Letztendlich wird sich im Jahr 2026 die Architektur durchsetzen, die ein optimales Gleichgewicht zwischen Einfachheit, Skalierbarkeit und Wartbarkeit bietet und dabei die Stärken modularer und monolithischer Systeme nutzt. Die Zukunft der Softwareentwicklung ist dynamisch, und Anpassungsfähigkeit ist der Schlüssel zum Erfolg.

Zusammenfassend lässt sich sagen, dass modulare Ansätze im Hinblick auf die Komplexität der Softwarearchitektur im Jahr 2026 voraussichtlich eine führende Rolle einnehmen werden. Der Weg dorthin dürfte jedoch Elemente sowohl monolithischer als auch modularer Strategien beinhalten. Durch die Nutzung hybrider Architekturen und Cloud- sowie DevOps-Praktiken können Unternehmen sicherstellen, dass sie für die sich wandelnde Technologielandschaft bestens gerüstet sind.

Die Integration von KI-Piloten und Web3-Systemen in autonome Drohnen – Wegbereiter der Zukunft

Digitales Gold verständlich gemacht Die komplexe Funktionsweise der Blockchain-Geldmechanismen